Wahrnehmung: Wenn Roboter wirklich sehen, hören und fühlen

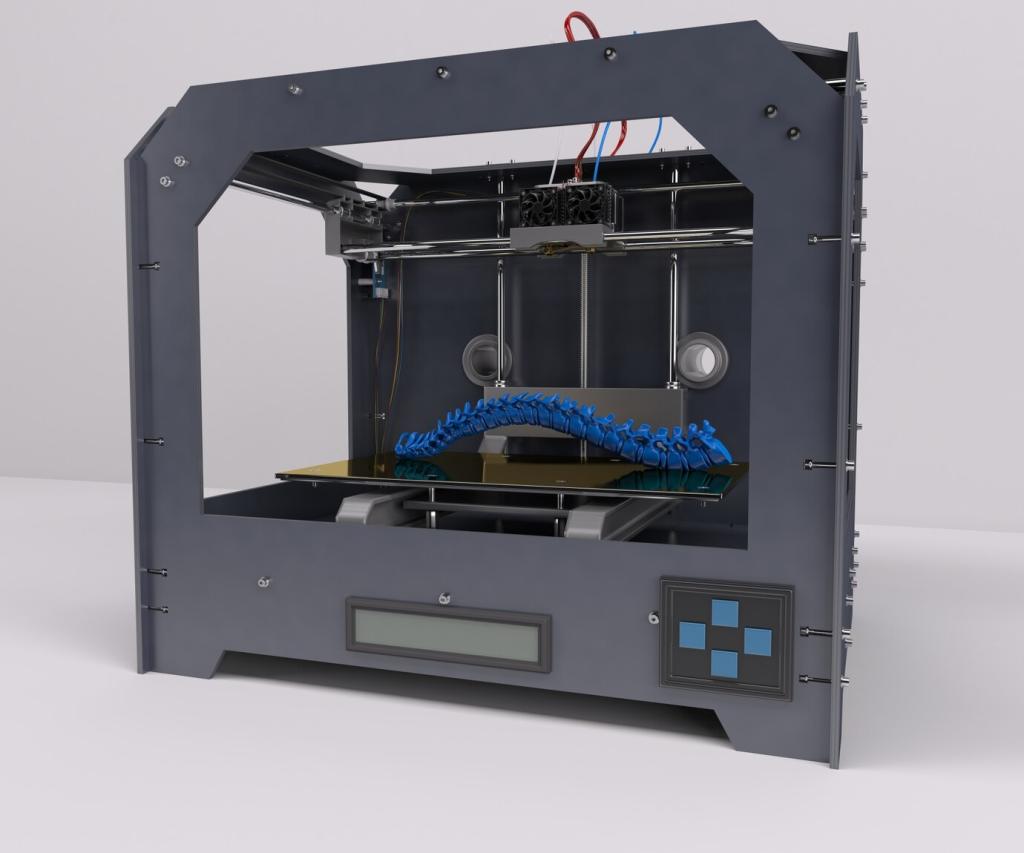

Segmentierung, Tiefenschätzung und 6D-Posen erlauben Greifern präzise Aktionen in unordentlichen Kisten. Multimodale Modelle verknüpfen Bild, Text und Geometrie, wodurch selbst unbekannte Objekte mit wenigen Beispielen handhabbar werden. Teile in den Kommentaren, welche Vision-Tools dir zuletzt echten Fortschritt brachten.

Wahrnehmung: Wenn Roboter wirklich sehen, hören und fühlen

Große Sprachmodelle übersetzen Wünsche in Handlungspläne: Hole die rote Kiste, aber meide das nasse Areal. Kontextlernen hilft, Begriffe an Orte zu binden. Datenschutz bleibt zentral: Viele Befehle werden lokal verarbeitet. Welche Sprachkommandos wünschst du dir im Alltag zuerst?

Wahrnehmung: Wenn Roboter wirklich sehen, hören und fühlen

Drucksensoren, Kraftregelung und körpereigene Rückmeldung machen Greifen behutsam statt brachial. Kombiniert mit visueller Vorhersage erkennen Roboter, wenn eine Schraube klemmt, und passen Drehmoment und Strategie an. Erzähle uns, wo du haptische Intelligenz heute noch vermisst – wir sammeln Beispiele.